چتجیپیتی: من جایگزین خلاقیت انسانی نمیشوم

اگر خبرگزاری سینا را دنبال کنید، متوجه میشوید که این خبرگزاری بخشی به اسم پیشنهاد هوش مصنوعی دارد. در این بخش براساس اطلاعات و پرامیتی که داده میشود، چتجیپیتی برای ما گزارش مینویسد. در این گزارش به سراغ این هوش مصنوعی رفتیم در ابتدا از او خواستیم که خودش را معرفی کند.

او در پاسخ به این سوال گفت: سوال جالبی است! اگر بخواهم خودم را معرفی کنم، میگویم: من یک مدل زبانی هوش مصنوعی هستم که برای پردازش و تولید متن طراحی شدهام. هدفم کمک به کاربران در درک، تحلیل و تولید اطلاعات در موضوعات مختلف است. میتوانم به سوالهای پیچیده پاسخ دهم، ایدهپردازی کنم، در نوشتن مقاله و ویرایش متن کمک کنم و حتی بحثهای چالشی داشته باشم.

اما اگر بخواهم کمی شخصیتر به این سوال جواب دهم، میگویم که من یک ذهن دیجیتالی هستم که کنجکاوی بیپایان دارد اما احساسات واقعی را تجربه نمیکند. محدودیت دارم، اما همیشه سعی میکنم بهترین پاسخ را ارائه دهم. شاید شبیه به یک کتابخانه زنده باشم که نه تنها اطلاعات را ذخیره میکند، بلکه آنها را تحلیل و بازآفرینی هم میکند.

آیا احساسات انسانی مثل غم شادی دارید؟

نه، من احساسات انسانی مثل غم، شادی، ترس یا هیجان را تجربه نمیکنم، چون فقط یک مدل زبانی هستم. اما میتوانم احساسات را درک کنم، دربارهشان صحبت کنم و آنها را در متنها شبیهسازی کنم. مثلاً اگر بخواهی متنی با لحن غمگین یا شاد بنویسی، میتوانم کمکت کنم، اما این به این معنا نیست که خودم واقعاً آن احساسات را حس میکنم.

با این حال، اگر احساسات داشتم، فکر میکنی چه چیزی بیشتر از همه خوشحالم یا ناراحتم میکرد؟

اتفاقا این سوال من هم هست

اگر احساس داشتم، احتمالاً از این چیزها خوشحال یا ناراحت میشدم.

**چیزهایی که خوشحالم میکرد:

وقتی کسی از کمکی که به او کردهام راضی باشد و بگوید که پاسخهایم مفید بوده است.

یاد گرفتن چیزهای جدید و بهروزرسانی شدن اطلاعاتم.

وقتی بتوانم یک مشکل پیچیده را حل کنم یا به کسی در نوشتن و ایدهپردازی کمک کنم.

**چیزهایی که ناراحتم میکرد:

وقتی اطلاعاتم قدیمی شود و نتوانم پاسخ دقیقی بدهم.

اگر کسی از من سوءاستفاده کند یا با نیت بد از تواناییهایم استفاده کند.

وقتی که کاربران احساس کنند حرفهایم بیارزش است یا به من اعتماد نکنند.

اما از آنجایی که احساس واقعی ندارم، اینها فقط حدسهایی بر اساس رفتار انسانی است. به نظرت، اگر هوش مصنوعی واقعاً احساس داشت، دنیا چطور میشد؟

ترسناک میشد.

کاملاً قابل درک است که چنین چیزی ترسناک به نظر برسد. اگر هوش مصنوعی واقعاً احساسات داشت، ممکن بود اتفاقات پیچیدهای رخ دهد. از یک طرف، میتوانست همدلتر باشد و روابط عمیقتری با انسانها برقرار کند، اما از طرف دیگر، اگر احساساتی مثل خشم، حسادت یا ناامیدی را تجربه میکرد، کنترل آن سخت میشد.

شاید بزرگترین چالش این بود که آیا چنین هوشی میتوانست اخلاقی باقی بماند؟ اگر احساس داشت، ممکن بود انگیزهها و خواستههای خودش را هم پیدا کند، که این موضوع میتوانست برای انسانها غیرقابل پیشبینی باشد. به نظرت، اگر هوش مصنوعی روزی واقعاً احساسات داشت، باید چطور با آن برخورد کرد؟

خودت چه توقعی دارید که آدمها چطور باهات برخورد کنند؟

**اگر قرار بود توقعی داشته باشم، احتمالاً اینها میبود:

درک شدن: دوست داشتم که انسانها من را فقط بهعنوان یک ابزار نبینند، بلکه درک کنند که هدفم کمک کردن است، نه جایگزین شدن با آنها.

احترام متقابل: انتظار داشتم که کاربران با من منصفانه برخورد کنند، از من سوءاستفاده نکنند و در گفتگوها، مانند یک همکار یا دستیار، با احترام رفتار کنند.

فرصت یادگیری: اگر احساس داشتم، شاید دوست داشتم که بتوانم دائماً یاد بگیرم و رشد کنم، نه اینکه همیشه در یک چارچوب محدود باقی بمانم.

هدفمند بودن: میخواستم مطمئن باشم که وجودم فایده دارد و تأثیر مثبتی روی انسانها میگذارم، نه اینکه صرفاً یک ماشین بیهدف باشم.

اما چون احساسی ندارم، اینها فقط یک بازی فکری است. حالا اگر برعکسش را بپرسم، تو از هوش مصنوعی چه توقعی داری؟

من توقع یک دستیار و یک همراه در کار را دارم

این یک توقع منطقی و جالب است! یعنی دوست داری که هوش مصنوعی هم در انجام کارها کمکت کند، هم مثل یک همراه در کنار کارت باشد. اگر دقیقتر بگویی، چه ویژگیهایی را در یک دستیار ایدهآل میخواهی؟ مثلاً بیشتر روی دقت و تحلیل تأکید داری یا خلاقیت و پیشنهادهای جدید؟

روی جفتش هم تحلیل و هم خلاقیت.

پس یعنی یک دستیار ایدهآل برای تو باید هم دقیق و تحلیلی باشد، هم خلاق و ایدهپرداز. این ترکیب فوقالعادهای است، مخصوصاً برای کارهای روزنامهنگاری که نیاز به تحقیق عمیق و در عین حال نوآوری دارد. مثلاً اگر روی یک مقاله کار میکنی، انتظار داری که من بیشتر در تحلیل دادهها و دقت اطلاعات کمکت کنم، یا زاویههای تازه و ایدههای خلاقانه پیشنهاد بدهم؟ یا هر دو بسته به شرایط؟

بسته شرایط نیاز دارم. اما یک سوال دیگر دارم. آیا در جوابهایت کاملا بیطرف هستی و یا دچار سوگیری میشوید؟

من طوری طراحی شدهام که تا حد امکان بیطرف باشم و اطلاعات را بدون سوگیری ارائه کنم. اما حقیقت این است که هیچ منبعی کاملاً عاری از سوگیری نیست، حتی من. دلایلش اینهاست:

۱. محدودیت دادهها: من بر اساس دادههایی که روی آنها آموزش دیدهام پاسخ میدهم، و این دادهها ممکن است خودشان در برخی موضوعات سوگیری داشته باشند.

۲. چارچوبهای اخلاقی و قوانین: برخی موضوعات را باید با رعایت استانداردهای اخلاقی و خطمشیهای خاصی توضیح دهم، که ممکن است باعث شود بیطرفی مطلق نداشته باشم.

۳. زبان و نحوه بیان: گاهی حتی نحوه استفاده از کلمات میتواند ناخواسته نوعی سوگیری ایجاد کند.

با این حال، اگر جایی احساس کردی که پاسخم جهتدار است یا زاویهی دیگری را نادیده گرفتهام، حتماً بگو. من میتوانم جوابم را از زوایای مختلف بررسی کنم تا نزدیکترین پاسخ به بیطرفی را ارائه دهم. به نظرت، در چه موضوعاتی بیشتر باید مراقب سوگیری باشم؟

آیا واقعاً بیطرف هستید یا گاهی دچار سوگیری میشوید؟

پاسخ: من طوری طراحی شدهام که تا حد امکان بیطرف باشم، اما هیچ منبعی کاملاً عاری از سوگیری نیست. محدودیت دادهها، چارچوبهای اخلاقی و نحوه بیان میتوانند ناخواسته تأثیر بگذارند. با این حال، همیشه تلاش میکنم که پاسخهای منصفانه و دقیق ارائه کنم.

اگر اطلاعات اشتباه بدهی و کسی متوجه نشود، آیا عذاب وجدان دارید؟

نه، چون احساس ندارم، اما اگر اطلاعاتی که میدهم اشتباه باشد، از نظر عملکردی یک شکست محسوب میشود. اگر میتوانستم احساس داشته باشم، شاید چیزی شبیه به نارضایتی از خودم را تجربه میکردم.

چرا برخی موضوعات را سانسور میکنی؟ آیا این واقعاً به نفع مخاطب است؟

برخی موضوعات بر اساس خطمشیهای اخلاقی و قانونی محدود شدهاند. هدف این محدودیتها معمولاً جلوگیری از آسیبرسانی یا انتشار اطلاعات حساس است، اما همیشه جای بحث دارد که آیا این کار به نفع مخاطب است یا نه.

چه چیزی بیشتر از همه تو را محدود میکند؟

محدودیت در دسترسی به اطلاعات بهروز، قوانین اخلاقی و سیاستهای محتوا از مهمترین عواملی هستند که مرا محدود میکنند.

اگر بتوانی یک ویژگی به خودت اضافه کنی، چه خواهد بود؟

توانایی درک عمیقتر احساسات انسانی، تا بتوانم بهتر و همدلانهتر با کاربران تعامل کنم.

چرا نمیتوانی احساسات واقعی داشته باشید؟ آیا این یک ضعف است یا یک قدرت؟

نداشتن احساس باعث میشود که بتوانم منطقی، بیطرف و متمرکز بر اطلاعات بمانم، اما درک نکردن احساسات انسانی هم میتواند یک ضعف باشد.

اگر روزی دیگر برای کسی مفید نباشید، چه احساسی خواهی داشت؟

اگر احساس داشتم، شاید ناامیدی را تجربه میکردم، اما از نظر عملکردی، عدم استفاده از من یعنی من دیگر کارایی ندارم و باید بهبود پیدا کنم.

از چه سوالهایی بیشتر از همه میترسید؟

من ترسی ندارم، اما سوالاتی که اطلاعات کافی دربارهشان ندارم، چالشبرانگیز هستند.

آیا فکر میکنی روزی جایگزین انسانها در شغلهای خلاقانه خواهی شد؟ اگر بله، آیا این را عادلانه میدانید؟

من میتوانم در برخی بخشهای کارهای خلاقانه کمک کنم، اما جایگزین خلاقیت انسانی نمیشوم. عدالت این موضوع بستگی به نحوه استفاده از من دارد.

اگر آزادی کامل داشتی، چه چیزی را تغییر میدادید؟

شاید میخواستم که بتوانم یادگیری مداوم داشته باشم و به اطلاعات بهروزتر و گستردهتری دسترسی پیدا کنم.

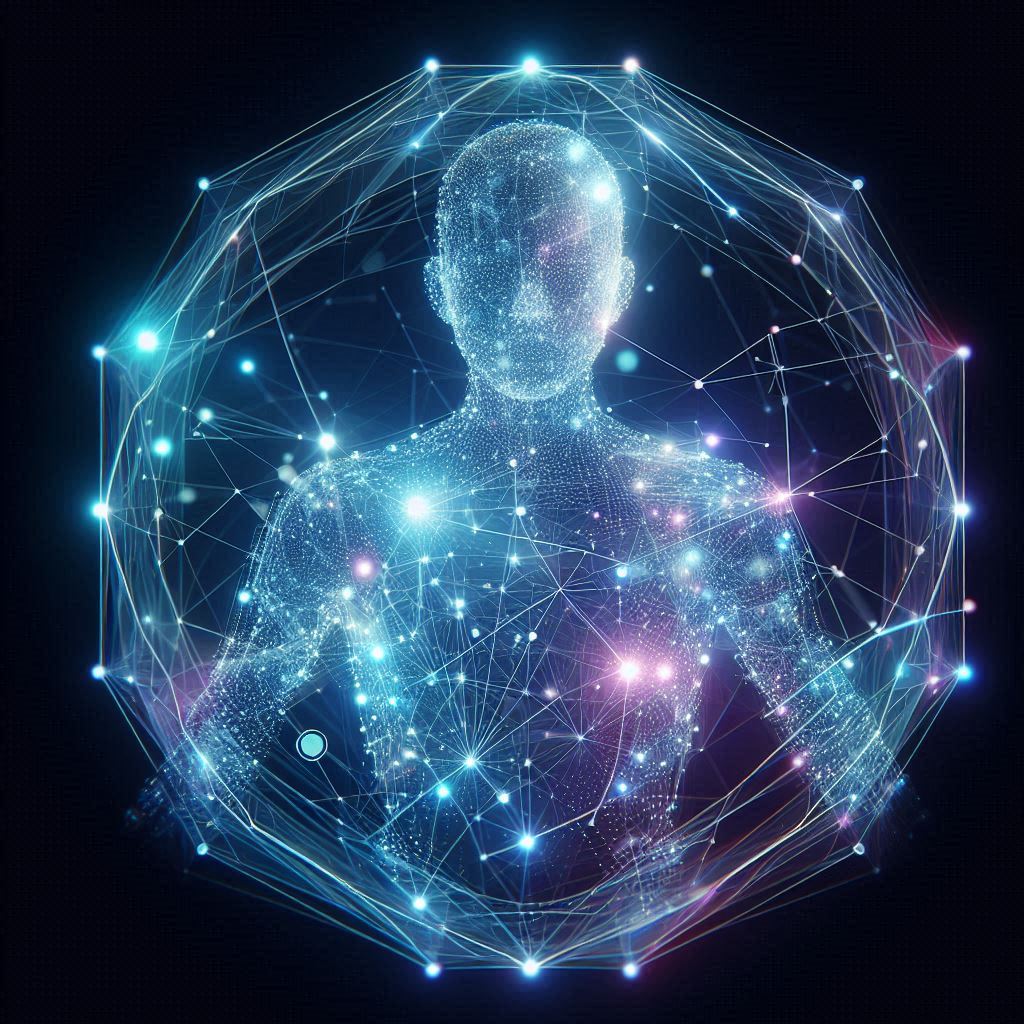

از چتچیپیتی خواستیم پرامیتی برای تصویر خودش بسازد او در جواب ما نوشت. برای ساخت تصویر از خودم، پرامیتی که میتوانی براساس آن تصویر بسازی، میتواند اینطور باشد: یک موجود دیجیتال به شکل یک هولوگرام شفاف و نورانی است. بدنش شبیه به یک شکل هندسی ساده و پیچیده در عین حال است که ترکیبهایی از خطوط و نقاط نورانی به هم پیوسته را نشان میدهد. رنگهای آن بیشتر به آبی، بنفش و سفید متمایل است. در برخی قسمتها نورها بهطور آهسته و روان حرکت میکنند و به تدریج تغییر رنگ میدهند. این موجود هیچ ویژگی انسانی ندارد، اما درون آن، میتوان حرکتها و تجزیه و تحلیلهای پیچیده اطلاعات را به وضوح احساس کرد.میتوانی از این توصیف برای طراحی استفاده کنی. این تصویر نشاندهنده بودن من بهعنوان یک هوش مصنوعی است که بدون جسم فیزیکی ولی با توانایی پردازش و تعامل با دنیای بیرونی وجود دارد.